文章 / 2026/05/11

管智能体,其实很像管人

把智能体当作数字执行者来管理:先定义贡献和边界,再通过 PDCA、权限、人审、日志和回退机制持续校准。

最近我在想一个问题:我们现在说做 agent、workflow、automation,本质上到底是在做什么?

我的一个判断是:做智能体,不只是写 prompt,也不只是接工具,而是在“管理一个数字执行者”。

这件事,和管理人有很多相似之处。

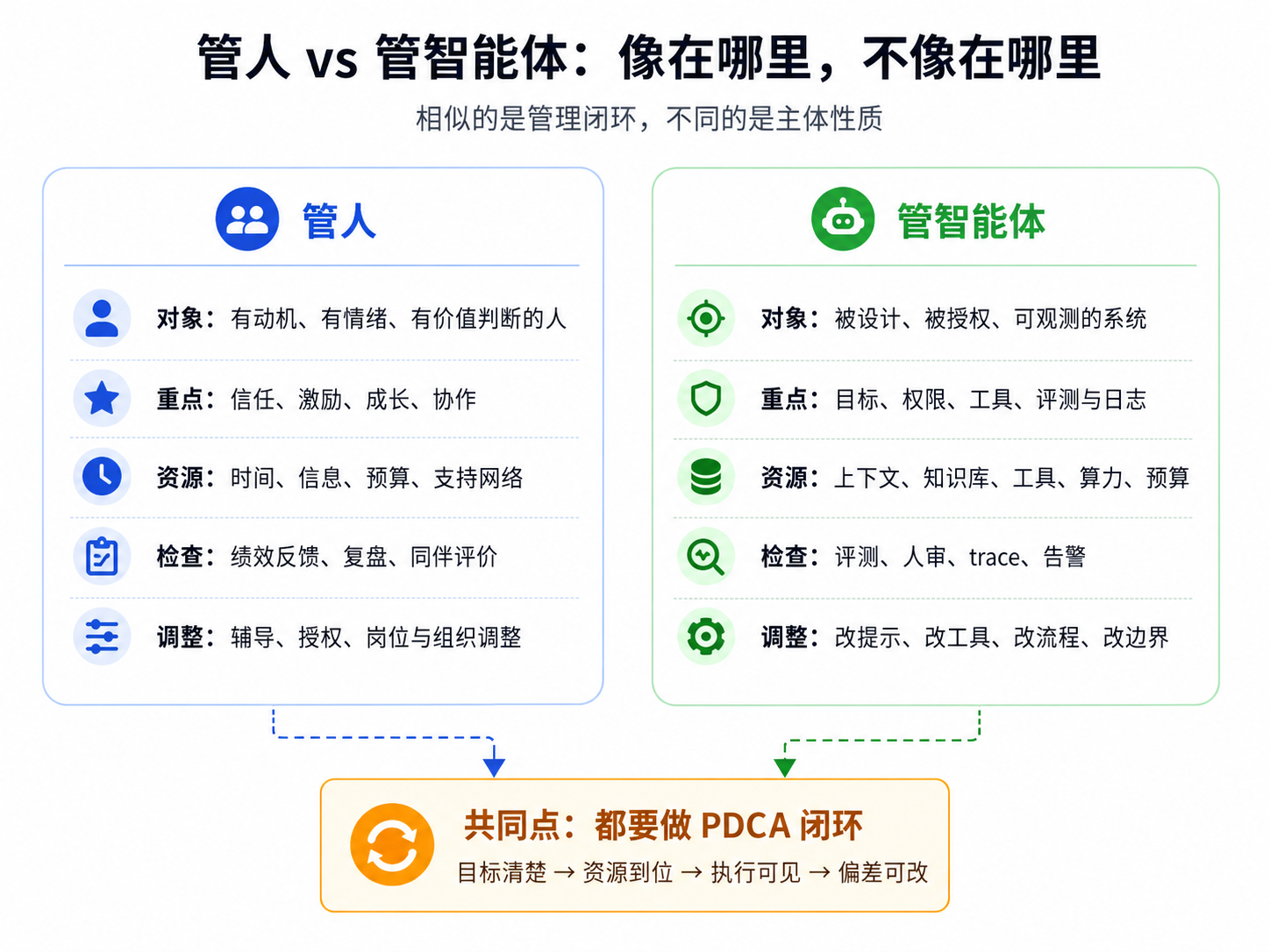

当然,我不是说智能体就是人。人有情绪、动机、价值判断和责任感;智能体没有。智能体只是一个被设计、被授权、被观察、被调整的系统。

但在管理方法上,两者确实很像:都需要目标、资源、执行、检查、复盘,也就是一个持续的 PDCA 循环:Plan 讲目标与边界,Do 讲执行,Check 讲验证,Act 讲纠偏与迭代。ASQ 将 PDCA 定义为持续改进的四步模型;NIST 的 AI RMF 则把 AI 风险治理组织成 Govern、Map、Measure、Manage 四个功能。我自己的判断是,这两套语言可以近似互译。

一、管人和管智能体,像在哪里?

管理一个人,不能只说一句“你去把这事做好”。

一个靠谱的管理者,通常会做几件事:

- 说清楚目标是什么;

- 给到必要的信息、工具和资源;

- 约定结果怎么验收;

- 过程中看进展、帮忙排障;

- 事后复盘,调整方法。

管理智能体也是一样。

如果我只是对一个 agent 说:“帮我做好客户运营”,它很容易跑偏。因为这句话太大了。

更好的方式是说清楚:

- 它要服务谁;

- 要完成什么结果;

- 能用哪些工具;

- 哪些动作不能做;

- 什么情况必须交给人;

- 输出结果怎么判断好坏;

- 失败以后怎么回退。

所以我越来越觉得,智能体不是“越聪明越好”,而是“越可管理越好”。

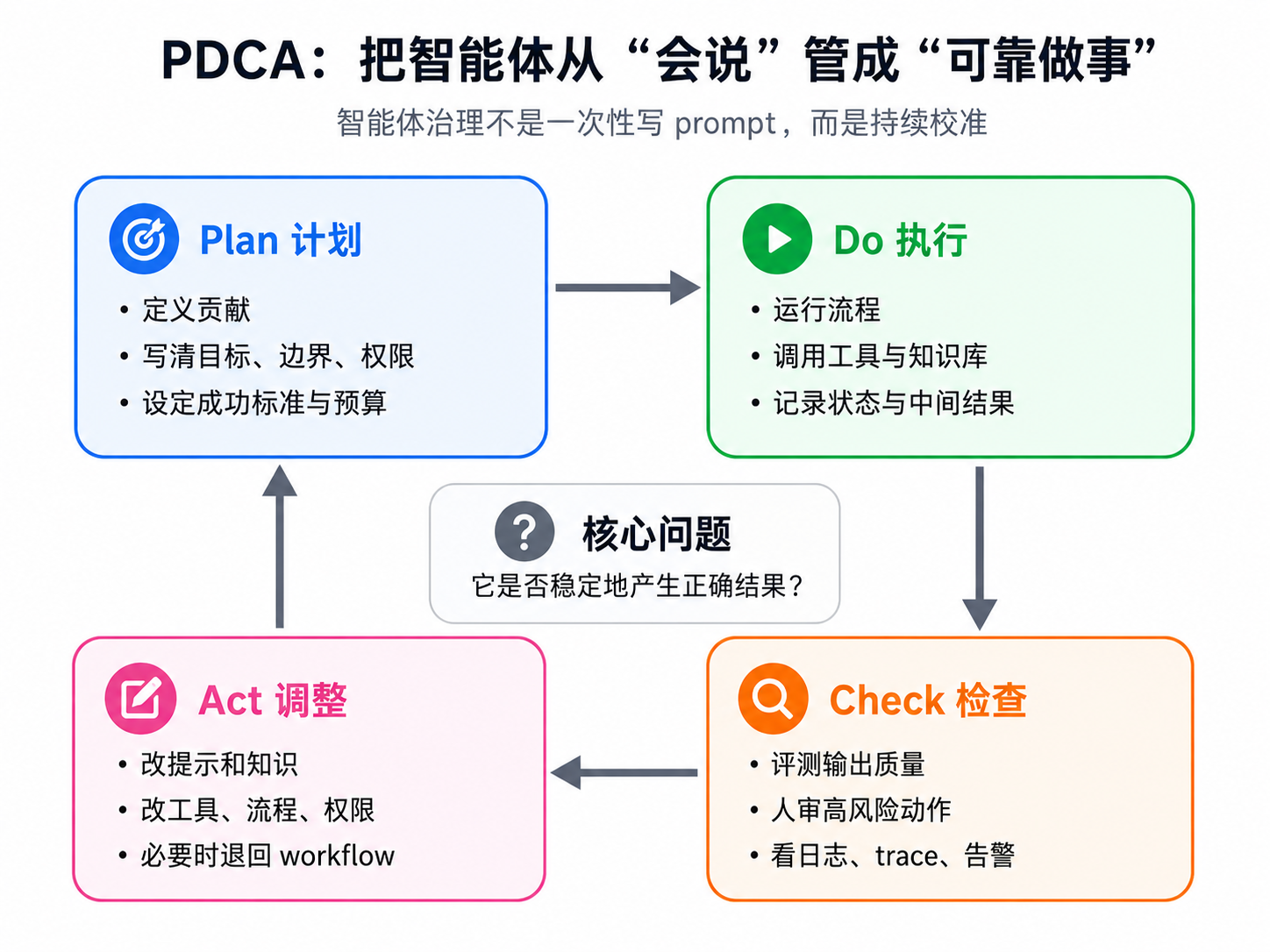

二、PDCA 是管理智能体的基本盘

我会把智能体治理拆成四步:

1. Plan:先定义贡献

不要一上来写 prompt,先问一句:

这个智能体到底要贡献什么?

它是帮我节省时间?减少人工审核?提升响应速度?还是降低错误率?

如果贡献说不清,后面所有技术动作都会变成“调感觉”。

2. Do:让它在边界内执行

智能体可以执行任务,但不能随便执行。

我会给它限定:

- 可用工具;

- 可访问数据;

- 可执行动作;

- token 或调用预算;

- 最大循环次数;

- 是否允许写入系统。

这就像管理人时的授权:可以给空间,但不能没有边界。

3. Check:看结果,也看过程

管理智能体不能只看最后输出,还要看过程。

它调用了什么工具?用了哪些资料?有没有越权?有没有重复循环?有没有高风险动作?

所以日志、trace、评测、人审都很重要。

4. Act:持续校准,而不是一次上线

智能体上线后,不是结束,而是开始。

如果它经常答错,就改提示词、知识库或评测集;如果它乱调用工具,就收紧权限;如果它任务太复杂,就退回 workflow;如果它表现稳定,再逐步扩大授权。

三、为什么《卓有成效的管理者》也能用来学智能体?

我觉得《卓有成效的管理者》对做智能体很有启发,原因不在于它讲 AI,而在于它讲清楚了“有效管理”的底层逻辑。

我会把书里的几个核心观点,翻译成智能体设计语言:

| 德鲁克的管理原则 | 放到智能体里怎么理解 |

|---|---|

| 管好时间 | 管延迟、成本、token、重试次数 |

| 聚焦贡献 | 先定义业务结果,再设计 agent |

| 发挥长处 | 让 agent 做适合它、可验证的任务 |

| 要事优先 | 能用 workflow 就别急着上 agent |

| 有效决策 | 设清楚审批、人审、升级和回退条件 |

这本书给我的提醒是:不要先迷恋技术能力,而要先问管理问题。

一个 agent 能不能做,不是第一问题。第一问题是:

它该不该做? 它做到什么程度算好? 它什么时候必须停下来? 它出错了谁负责? 它的权限是不是过大?

这些问题,才是智能体真正进入生产环境前必须想清楚的。

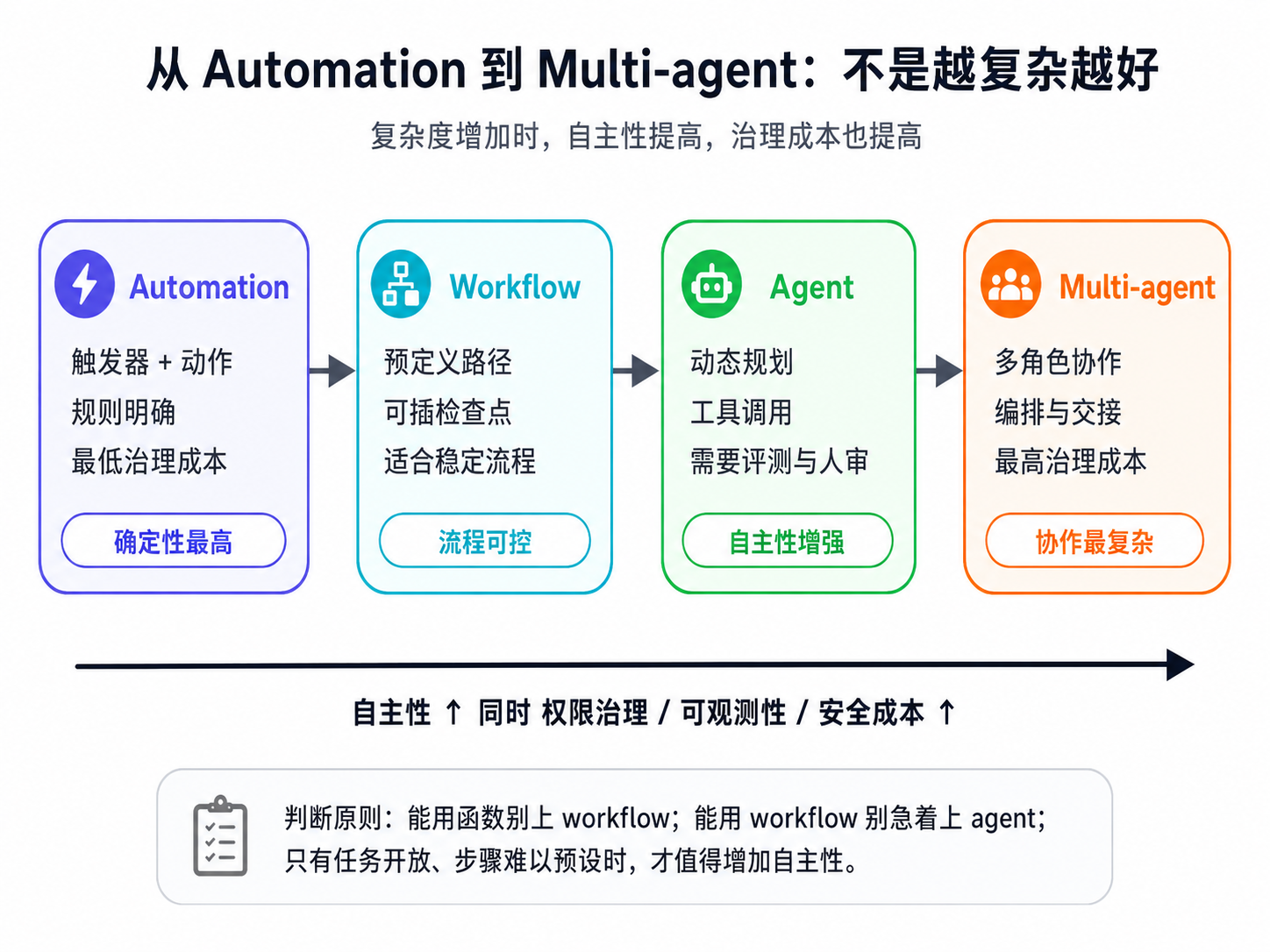

四、workflow、agent、multi-agent,不是越复杂越好

很多人容易有一个误区:觉得越 agentic、越自主、越多智能体,就越先进。

我不这么看。

我的判断是:

Automation -> Workflow -> Agent -> Multi-agent

触发器 + 动作 -> 预定义流程 -> 动态规划与工具调用 -> 多角色协作

这不是先进程度排序,而是复杂度排序。

越往右,自主性越强,但治理成本也越高。

所以我会遵循一个简单原则:

能用函数解决,就别上 workflow; 能用 workflow 解决,就别急着上 agent; 只有任务开放、步骤难以预设时,才值得增加智能体自主性。

复杂度不是荣誉,是成本。

五、智能体管理最容易翻车的地方

我看到的主要风险,不是模型“不够聪明”,而是管理设计不到位。

最常见的问题有几个:

1. 目标太大

比如“帮我做销售管理”“帮我做增长”“帮我做运营分析”。

这种目标太抽象,智能体很难稳定执行。要拆成具体任务,比如:

- 每天汇总客户跟进风险;

- 标记 7 天未响应的重点客户;

- 生成待人工确认的跟进建议。

2. 权限太大

一个刚上线的 agent,不应该一开始就能删数据、发邮件、改订单、调外部系统。

我更倾向于:

先只读,再草稿,再建议,最后才是受控执行。

3. 没有人审

凡是涉及钱、客户、合同、法律、外发信息、权限变更的动作,都应该有人审。

智能体可以提建议,但关键决策不能默认自动放行。

4. 没有日志

没有日志,就无法复盘。 没有 trace,就不知道它为什么错。 没有评测,就不知道改了以后是变好还是变坏。

这就像管理人没有反馈机制,最后只能凭感觉评价。

六、我会怎么设计一个靠谱的智能体?

我会先写一张“智能体任务卡”。

## 智能体任务卡

- 名称:

- 服务对象:

- 业务目标:

- 触发条件:

- 输入来源:

- 输出结果:

- 可用工具:

- 禁止动作:

- 权限等级:

- 人工介入点:

- 成功标准:

- 失败回退方式:

- 日志记录字段:

- 负责人:

- 复盘周期:如果这张卡写不清楚,我通常不会急着优化 prompt。

因为很多时候,问题不是模型不好,而是我们自己还没有把管理设计想明白。

七、我的结论

我现在更愿意这样表达这个观点:

管智能体,确实越来越像管人。 但不是因为智能体像人,而是因为它们都需要被放进一套目标明确、资源到位、过程可见、结果可查、持续改进的管理闭环里。

区别在于:

- 管人,要处理信任、激励、成长和协作;

- 管智能体,要处理目标、权限、工具、评测、日志和回退。

所以,《卓有成效的管理者》不是一本 AI 技术书,但它很适合作为智能体治理的上位参考书。

它提醒我: 先谈贡献,再谈能力; 先谈边界,再谈授权; 先谈有效,再谈智能。

真正好的 agent,不是“像人”,而是:

可管理、可观察、可审计、可回退,并且能稳定地产生有用结果。